こうやって無意識に脳にアプローチされる世界になって行くのでしょうか?

機械学習を使ってリアルなフェイク動画を作る「ディープフェイク」ですが、どんどんフェイクっぽさがなくなってきて怖いレベルです。ディープフェイクの動画の発展は、いいのか悪いのか日々進んでいます。そして今回、カーネギーメロン大学の研究チームがある人の表情や仕草を自動的に他の人に当てはめる方法を開発しました。

「たとえば、オバマ前大統領の話し方のスタイルをトランプ大統領に移すことができたりします」とYouTube動画内では説明がされています。

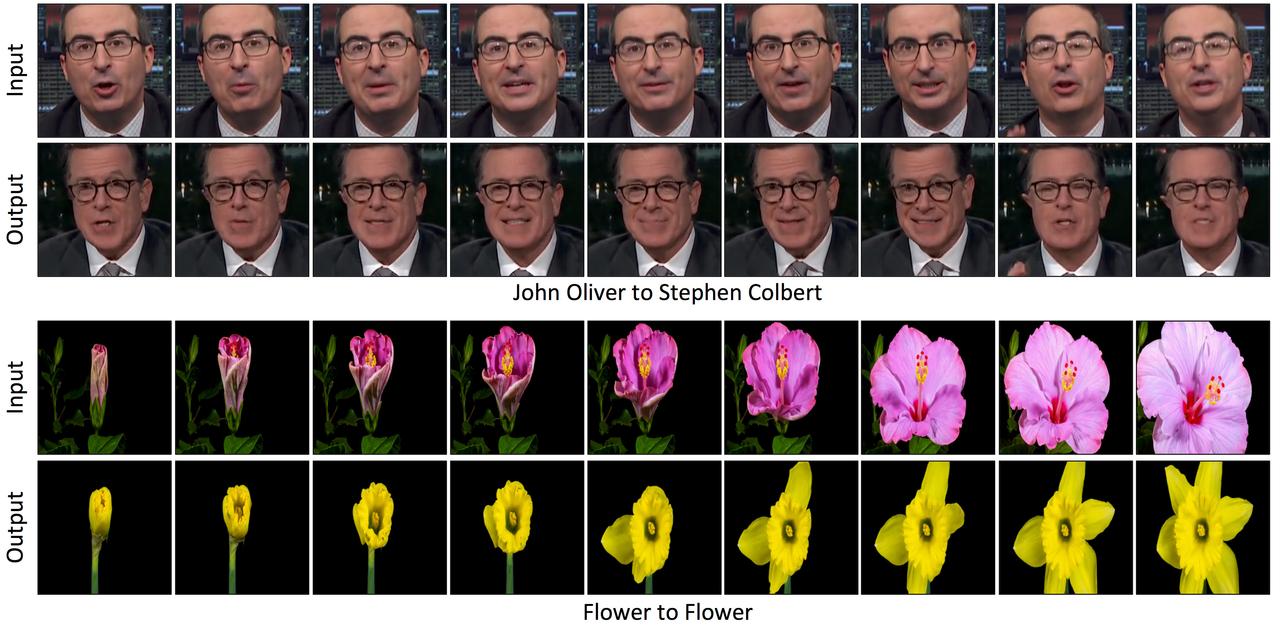

このビデオではイギリスの人気コメディアンのジョン・オリバーの仕草を同じく人気コメディアンのスティーヴン・コルベアと、アニメのカエルに移しています。マーティン・ルーサー・キング・ジュニアをオバマさんに、オバマさんをトランプにと自由自在です。

最初の例であるジョン・オリバーからスティーヴン・コルベアですが、右のコルベアに注目していると、低解像度でぐにゃっとなっているのでフェイクだなってわかりやすいですよね。でも他の例では、「画質が悪いのかな」と思うくらいで、表情をコピーしてるというのはわかりにくいですよね。その人(もの)の元々の仕草や動きだと言われても不審に思わないレベルです。

今回の研究では、AIを使って顔の表情や話し方を他の人に移すということだけではなく、水仙の開花の様子をハイビスカスに移したり、日が昇る様子を日が沈む様子に当てはめたりと色々なことに挑戦しています。

顔の表情を移し替えるにあたって、例えばジョン・オリバーが笑う時にできるえくぼや、トランプの話す時の口の形、コルベアの口元のしわなど小さな癖まで移し替えることができるとしています。

これって、ものすごくいろんなことに使えてしまいますよね。たとえば、(今でも十分リアルですが)さらにリアルなアニメができたり、あまり表情の演技の上手ではない俳優にこれを使うとか。あとは怖いですが、政治的なプロパガンダとしても使えてしまいそうです。

こうやって機械に知らない間に騙されていくって、ちょっと震える...。