みんなにバレないようにピカチュウトークしましょうか。

ボイスコントロールによるアシスタント機能は便利ですが、うるさい場所では使いにくいのが現状です。また他の人がいる前でナイショのことをしゃべったりするのは危険。英語で喋ったってバレちゃうかもしれないし。

声には出せないこのキモチ。AlexaやGoogleアシスタントに届けたい。その思いがソニーCSLで結実したようです。

AI×超音波エコー映像がもたらすSottoVoce

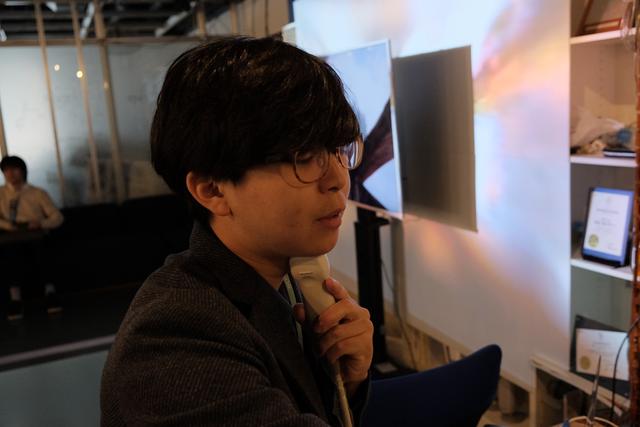

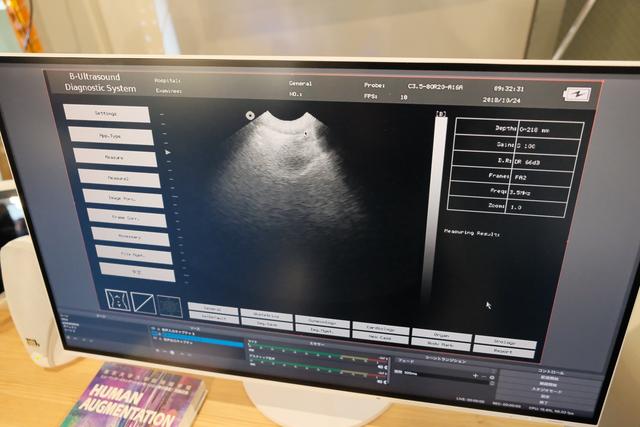

顎の下に超音波診断装置用プローブを当て、口パクで喋っているときの口の中の状態をスキャン。あらかじめディープラーニングしておいた口腔内のデータを照らし合わせ、声を出さなくても、どんなボイスコマンドを喋っているかをスマートスピーカーなどに伝えるシステムが「SottoVoce」です。

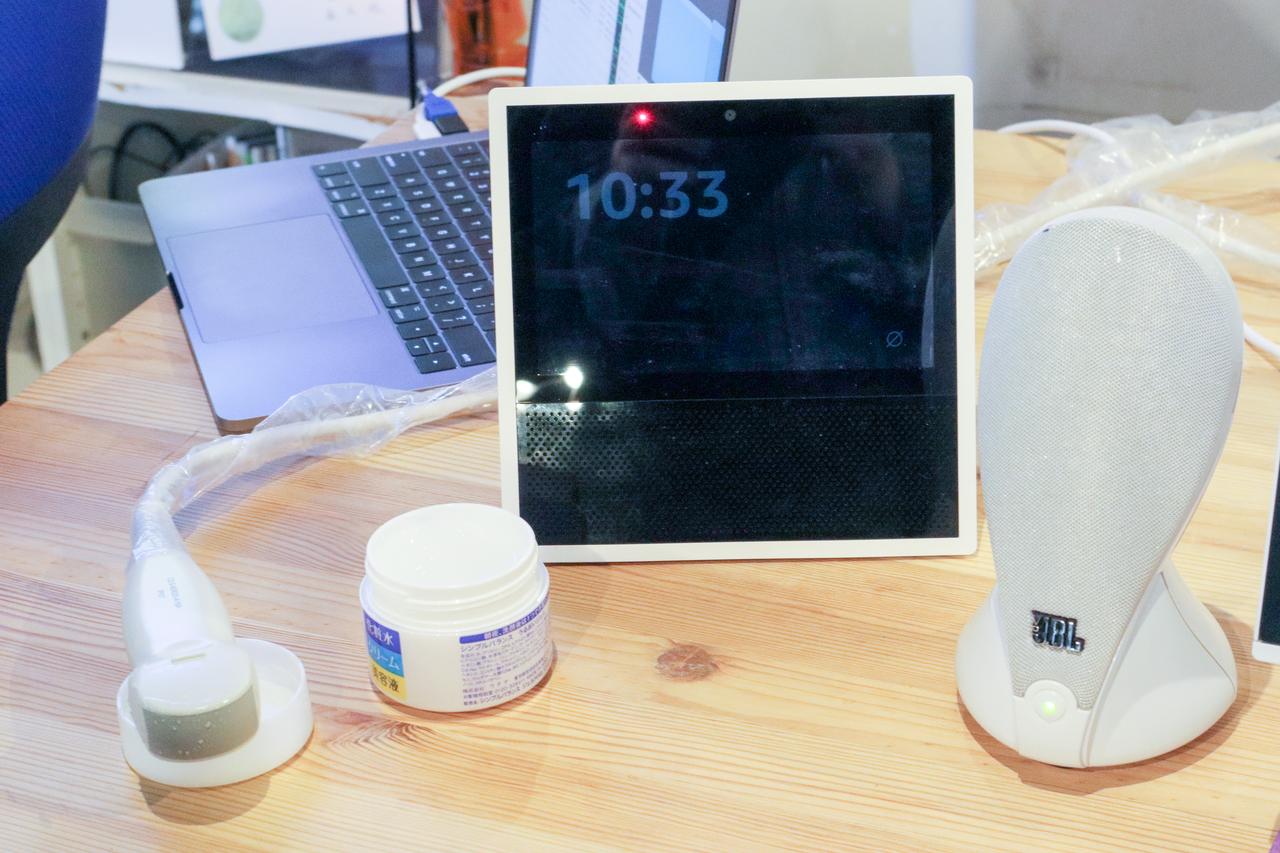

現状は医療用の技術・機器を使っているため、超音波診断装置用プローブを持つ必要があります。でも顎の下に装着できる、ウェアラブルな小型プローブを開発できればフリーハンド。両手でキーボード&マウスを操作し、声を出さなくても音声アシスタントと会話できるようになるのでしょう。

「SottoVoce」は、ソニーと東京大学が推進しているヒューマンオーグメンテーション学研究の一環によるもので、人間とテクノロジーの融合化をさらに進めるというもの。この学問の先にあるのは攻殻機動隊の実現ってことなのでしょうか。