Pixelをコンコンとノックするだけ。

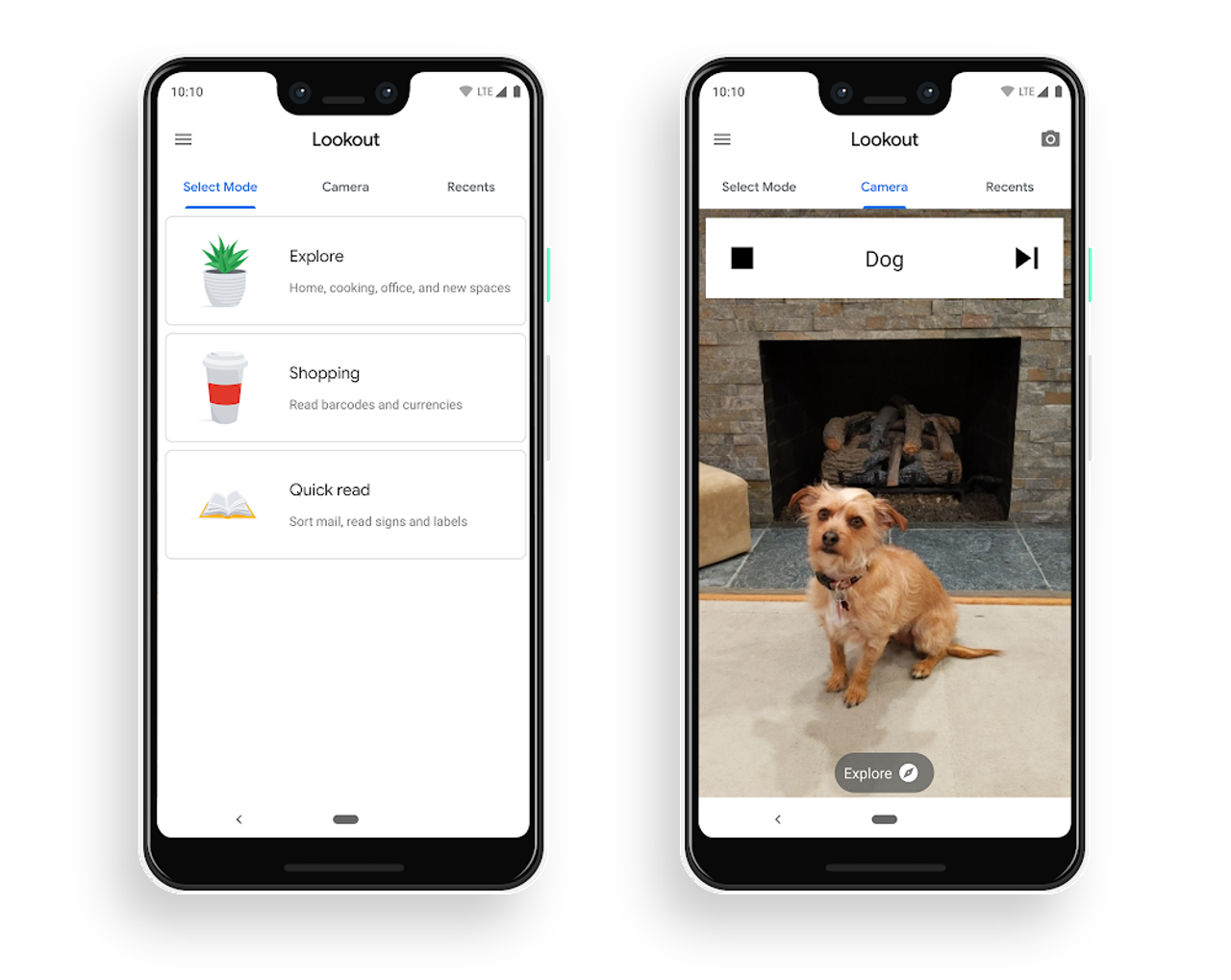

Google(グーグル)が視覚障害、もしくは弱視など目の弱い人たちにとっても、スマートフォンがますます便利なツールを作ってくれました。それはGoogle Playにやって来た「Lookout」というアプリで、目の前の物体やテキストなどにカメラを向けると、それがなんなんかを瞬時に音声で教えてくれるというもの。

Pixel本体をコンコンとノックすることで、アプリが物体を認識してくれるようですね。映像では「ハサミは12時の方向です」と方向まで教えてくれています。Fresh Gadgetsいわく、これはAIの機能が格段に向上したからとあります。

Googleによると、このアプリは現在アメリカでAndroid 8.0以降を実装しているPixel 1、Pixel 2、およびPixel 3で利用でき、言語は今のところ英語のみとのことです。Google Pixelをストラップで首から下げるか、胸のポケットに入れるなどでカメラを外側に向けていれば、文字を読んだり料理や掃除や買い物など、普段の作業を音声でアシストしてくれます。

昨年の「Google I/O」でコンセプトを発表して以来、ずっと実用化に向けて開発をしてきたLookout。まだ発展途上なので、完璧にアシストが出来るわけではなさそうですが、それでもあれば大助かりなアプリでしょうし、ユーザーからのフィードバックでどんどん改善されていってほしいです。

Source: YouTube via Fresh Gadgets, Google, Google Play